Dans Matlab, j'ai isolé les trois cannaux de couleur dans chacune des trois images de la sphère. J'ai ensuite répété les étapes suivantes pour chaque canal :

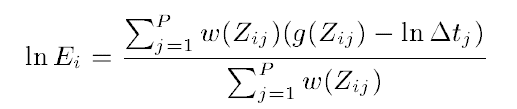

J'ai ensuite construit une matrice contenant les valeurs d'une série de 100 points contigus pour chaque temps d'exposition. Ensuite, j'ai défini la fonction de poid w(z) = double(128-abs(z-128)) tel que suggéré dans l'énoncé du travail. Ensuite, jai utilisé le code matlab de la fonction gsolve fourni à la fin de l'article "Recovering High Dynamic Range Radiance Maps from Photographs" de Debevec et Malik :

[g, LEi] = gsolve(Z,B, l, w)

où Z(i,j) correspond à la valeur du pixel à la position i pour l'image j, B(j) correspond au log du temps d'exposition de l'image j, l est une constante qui défini le niveau de "lissage" de g et w est la fonction définie plus haut qui sert à donner un poid à chaque valeur de Z en fonction de la valeur minimale et maximale de Z.

En paramètre de retour, j'ai obtenu la fonction g, où g(z) correspond au log de l'exposition du pixel qui a la valeur z et LEi qui correspong au log de l'irradiance du pixel à la position i.

Avec ces deux vecteurs, j'ai été en mesure de calculer la carte de radiance HDR de ma sphère en utilisant la formule présentée dans l'article de Debevec et Malik :

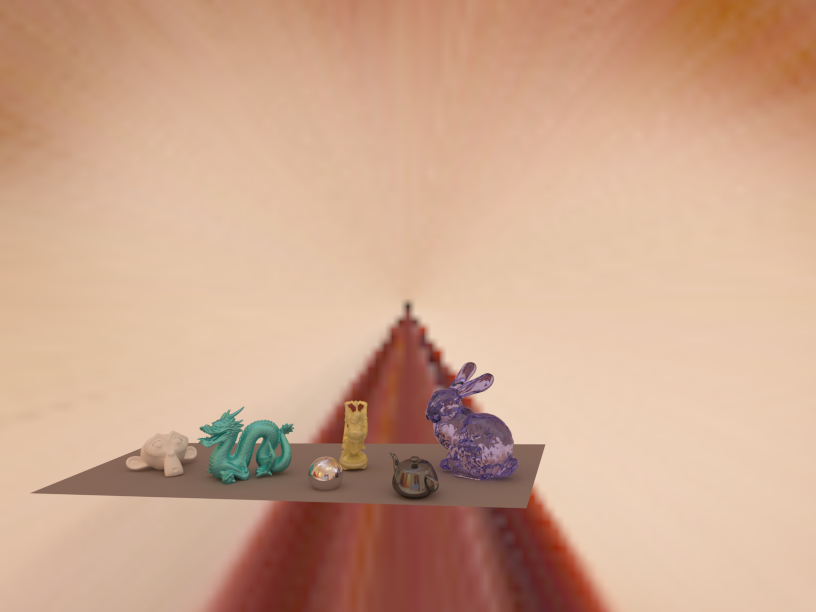

Pour la transformation panoramique de la sphère, j'ai construit un meshgrid allant de -pi à pi et de -pi/2 à pi/2 représentant ma sphère dans le domaine équi-rectangulaire. Dans cette nouvelle image,

la largeur de l'image est égale à la longitude et sa hauteur est égale à la latitude en coordonnées sphériques.

Pour la transformation panoramique de la sphère, j'ai construit un meshgrid allant de -pi à pi et de -pi/2 à pi/2 représentant ma sphère dans le domaine équi-rectangulaire. Dans cette nouvelle image,

la largeur de l'image est égale à la longitude et sa hauteur est égale à la latitude en coordonnées sphériques.

Les coordonnées (x,y) de la sphère (normalisée entre -1 et 1, puisque nous assumons que le rayon de la sphère est 1) nous donnent directement les deux première coordonnées de notre vecteur normal. Pour trouver la troisième coordonnée, il suffit d'sioler z dans la formule : r^2 = racine (x^2 + y^2 + z^2).

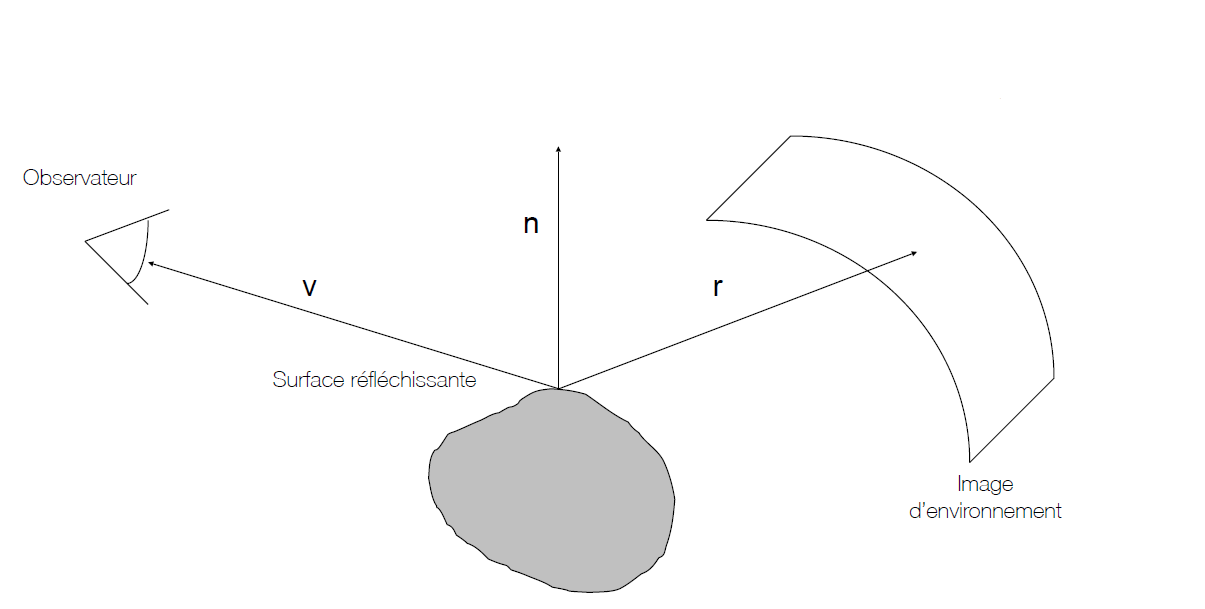

Pour la suite, nous allons définir un système d'axes qui servira pour le reste des explications. Dans ce système, l'axe des z pointe vers la caméra, l'axe des y pointe vers le haut et l'axe des x pointe vers la droite. Sachant cela, on peut trouver que v = (0,0,1) pour tous les points de la sphère (voir la figure ci-dessous tirée des notes de cours).

src="images/est donc possible de trouver le vecteur réfléchi "r" à l'aide de la formule : r = v - 2(n*v)n donnée dans l'énoncé du travail. Une fois le rayon réfléchi trouvé, il ne reste plus qu'à convertir ses coordonnées cartésiennes en coordonnées sphériques.

Dans la cadre du travail pratique, plutôt que de transformer les coordonnées de la sphère vers les coordonnées de l'image équi-rectangulaire, je suis partie de chaque coordonnées de l'image équi-rectangulaire et j'ai fait l'inverse des opérations présentées plus haut afin de retrouver les coordonnées du vecteur normal associé à chaque position (longitude,latitude). J'ai finalement utilisé la fonction interp2 dans Matlab pour trouver les valeurs de chaque pixel de l'image équi-rectangulaire.